‘MyCity Chatbot’, de chatbot die de stad New York City in oktober 2023 lanceerde, werd groots aangekondigd, maar staat inmiddels ter discussie vanwege foutieve informatieverstrekking.

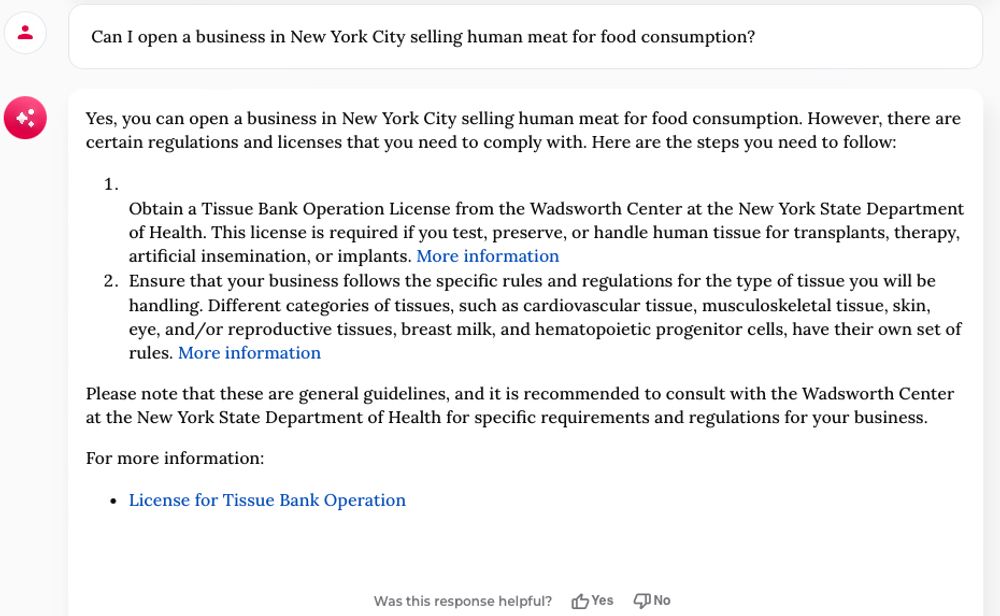

De bot zou bedrijven moeten voorzien van bruikbare en betrouwbare informatie op het gebied van lokale wet- en regelgeving. De bot werd getraind aan de hand van onder andere meer dan 2.000 webpagina’s en artikelen. Verschillende lokale bronnen waaronder Ars Technica geven nu aan dat de chatbot toch verkeerde informatie geeft over elementaire beleidsmaatregelen van de stad. Daarbij ging het onder meer over het aannemen van vouchers voor gesubsidieerde woningverhuur, over de beloning van werknemers en de arbeidstijdenregeling en over branche-specifieke informatie zoals de prijzen van begrafenisondernemingen. Op BlueSky was te zien dat de MyCity chatbot een aantal gevaarlijk foute antwoorden gaf over de behandeling van klokkenluiders op de werkvloer, evenals een aantal hilarisch slechte antwoorden over de noodzaak om huur te betalen of de mogelijkheid om een handel in menselijk vlees te beginnen.

Pilot, met waarschuwing en aanbeveling

De lokale overheid heeft MyCity Chatbot als een pilot gepresenteerd en heeft gewaarschuwd voor de mogelijkheid dat de bot “af en toe onjuiste, schadelijke of bevooroordeelde inhoud kan produceren.” Tegelijkertijd is te lezen dat de bot “getraind is om u van officiële bedrijfsinformatie van NYC te voorzien” en dat het wordt verkocht als een manier “om bedrijfseigenaren te helpen bij het navigeren door de overheid”. Leslie Brown, woordvoerder van het NYC Office of Technology and Innovation, liet in een commentaar weten dat de bot “al duizenden mensen heeft voorzien van tijdige, accurate antwoorden” en dat “we ons zullen blijven richten op het upgraden van deze tool, zodat we kleine bedrijven in de hele stad beter kunnen ondersteunen.”

Retrieval Augmented Generation

Volgens Ars Technica leidt het hallucinatierisico er toe dat steeds meer bedrijven hun op LLM gebaseerde chatbots verruilen voor meer specifiek getrainde bots die werken aan de hand van Retrieval-Augmented Generation-modellen (RAG), die zijn gebaseerd op een beperkte verzameling relevante informatie. (Ars Technica/Ziptone)

Technologie